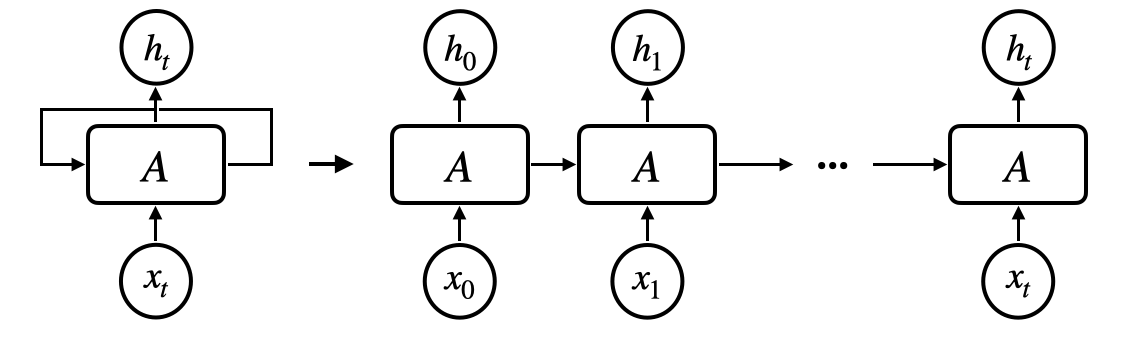

본 글에서 리뷰할 논문은 2014년 NeurIPS에 게시된 Sequence to Sequence Learning with Neural Network 이다.

Sequence to Sequence

논문 제목에서 알 수 있듯이 본 논문은 Neural Network로 이루어진 Sequence to Sequence(이하 Seq2Seq) 모델을 소개하고 있다. Seq2Seq 모델은 어떤 모델일까?

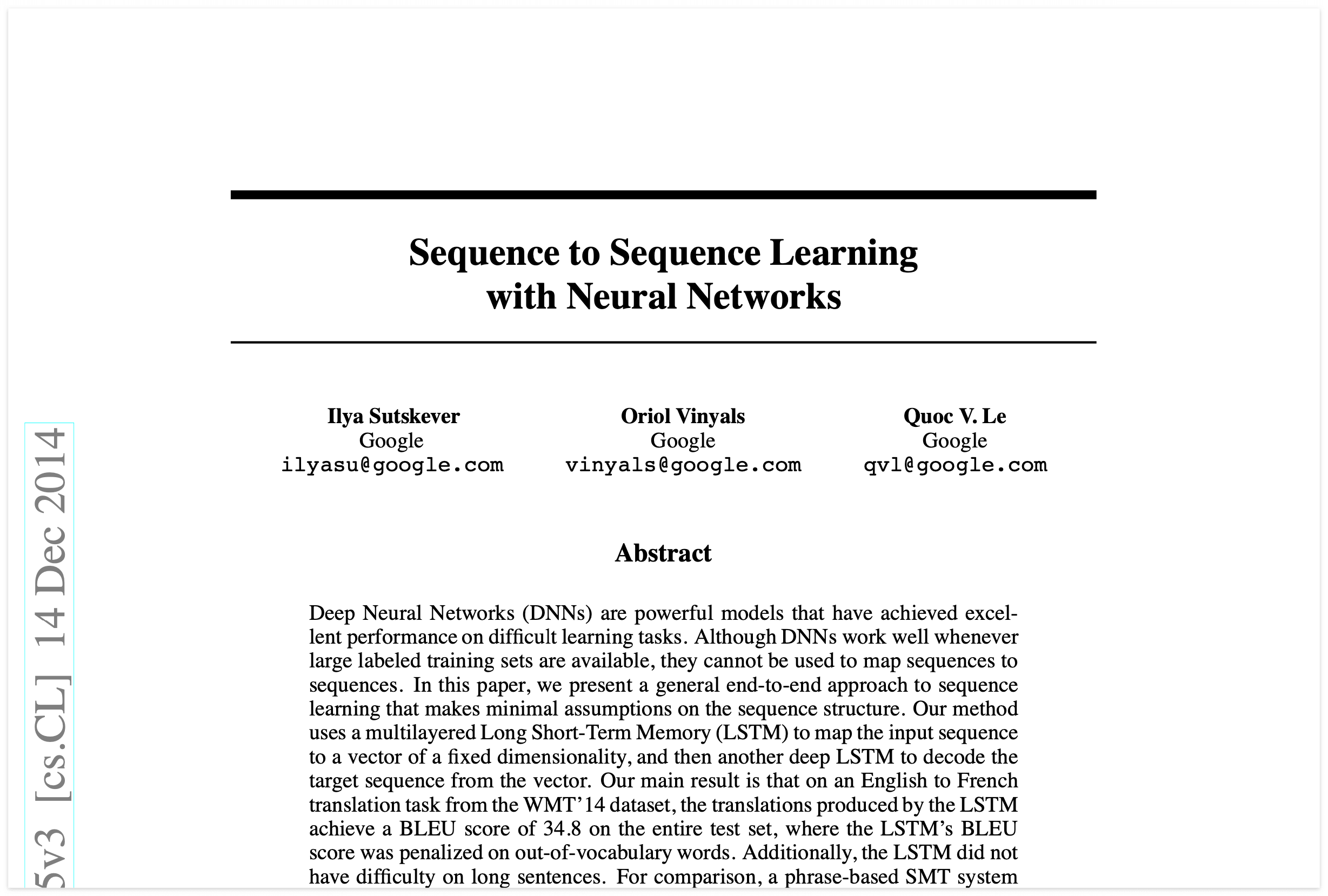

위 그림과 같이 어떠한 Sequence $\{A, B, C\}$ 가 입력되면, 그에 대응하는 Sequence $\{W, X, Y, Z\}$ 를 출력하는 모델을 Seq2Seq 모델이라 한다. 여기서 사용되는 Sequence Data는 길이가 정해져 있지 않다. 즉, 가변적인 문장을 입력으로 넣으면 또 다른 가변적인 문장을 출력하는 것이다. 입력 문장과 출력 문장 길이가 다른 대표적인 상황은 '번역'할 때다. 한국어 문장을 영어 문장으로 번역한다고 가정해보자. 이때, 한국어 문장의 단어 수와 영어 문장의 단어 수가 항상 같아야 한다면 매우 이상한 문장으로 번역될 것이다. 따라서 Seq2Seq은 Machine Translation, Speech Recognition과 같은 NLP Task에서 사용된다.

Why Use the Sequence to Sequence Model

그렇다면 왜 가변 길이의 Sequence Data를 다룰 때 DNN이나 Single RNN이 아닌 Seq2Seq 모델을 사용할까?

DNN

DNN을 사용할 수 없는 이유는 명확하다. DNN에서 필요로 하는 Input, Output Data는 고정된 차원 벡터이기 때문이다. 따라서 Seq2Seq에서 사용하는 가변 길이의 Sequence Data를 입력으로 사용할 수 없다. 또한, Sequence Data의 순서 정보를 학습할 수 없다는 점도 치명적인 약점으로 꼽힌다.

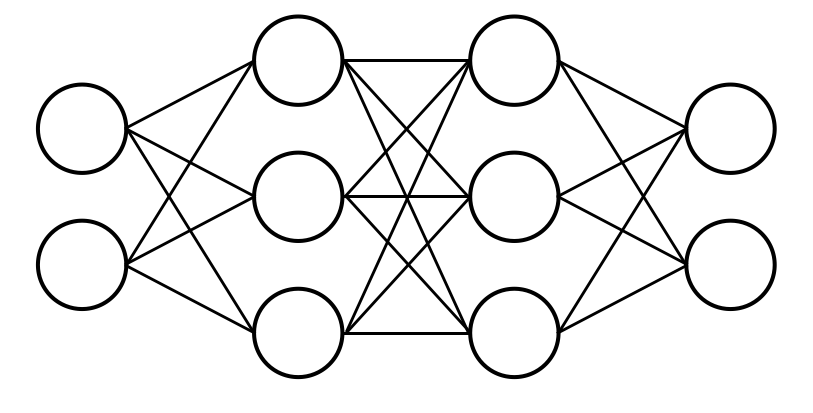

Single RNN

앞서 작성한 DNN의 단점을 극복하기 위해 만들어진 모델이 RNN이며, Sequence Data에 특화된 모델이다. RNN은 Input Sentence의 Tocken(단어) 하나 하나를 입력으로 사용하고, 이에 대응하는 새로운 단어를 출력하는 방식으로 동작한다. 따라서 Input Sequence와 Output Sequence의 길이가 같아야 한다. 하지만 Seq2Seq에서 풀고자 하는 Translation이나 Speech Recognition은 Input과 Output 길이를 동일하게 설정하면 원하는 성능을 보일 수 없다. 이런 한계점으로 Single RNN이 아닌 Seq2Seq 모델을 사용하게 됐다.

Encoder-Decoder

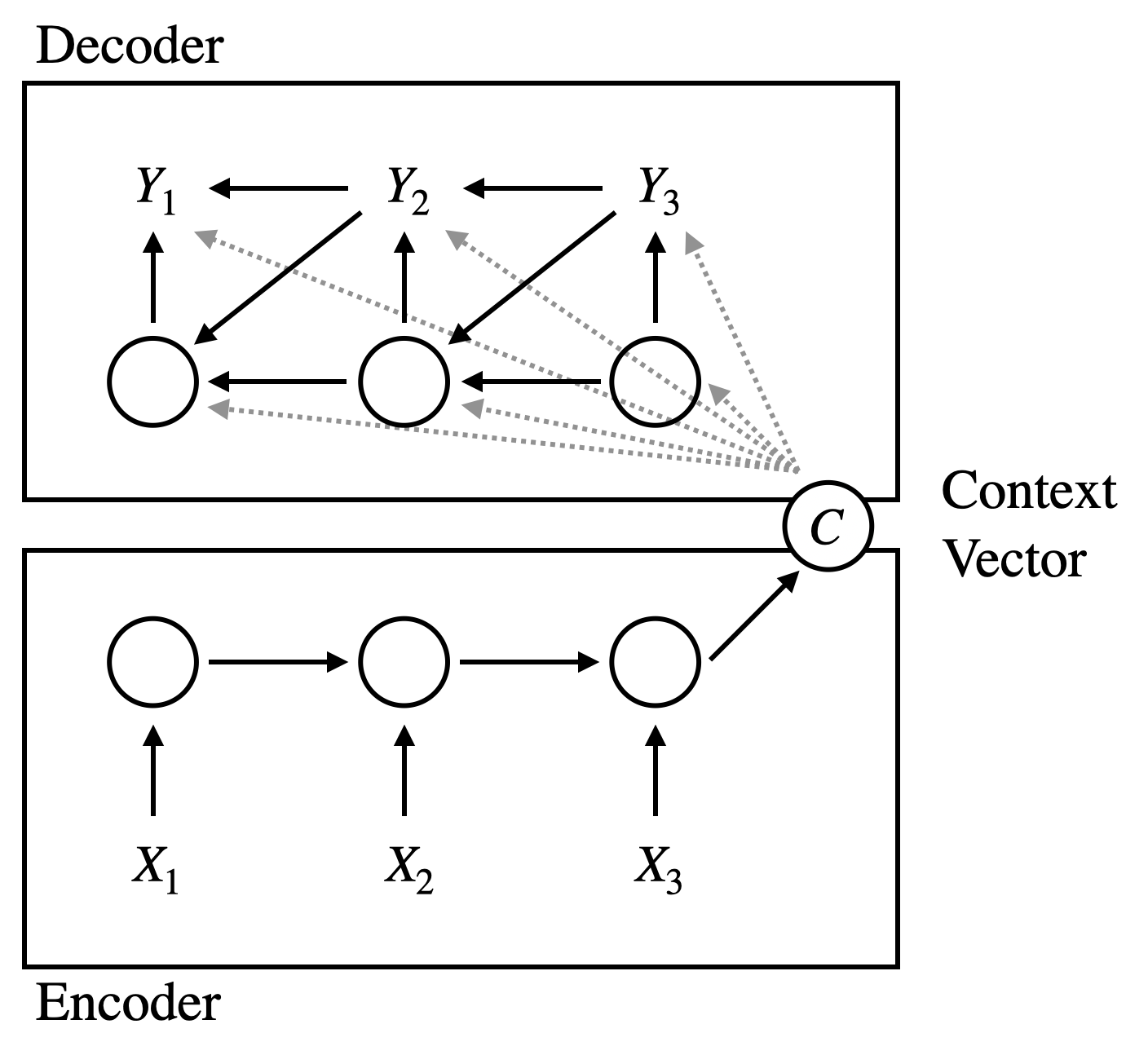

Sequence Data를 다루는 Seq2Seq 모델은 RNN을 사용한다. 하나의 RNN을 사용하면 입력과 출력의 길이가 같아야 하기 때문에 사용하기 어렵다고 위에서 언급했다. 그렇기 때문에 Seq2Seq는 두 개의 RNN으로 이루어져 있다. 그리고 RNN 각각을 Encoder, Decoder 라 명칭한다. 즉, Seq2Seq는 Encoder-Decoder 구조로 구성된 모델이라 할 수 있다.

Encoder는 Input Sequence를 받아 하나의 고정된 벡터(Context Vector)를 출력한다. 그렇게 출력된 Context Vector를 Decoder에서 Input으로 받아 Output Sequence를 출력하게 된다. 즉, Encoder에서 Input Sequence를 단어(token) 하나 하나로 쪼개 Decoder의 입력으로 사용하지 않고, 하나의 Context Vector를 Input Sequence 전체를 하나의 입력 단위로 보고 Decoder에 전달해준다. 이러한 특징으로 Input Sequence과 다른 길이를 가진 새로운 Output Sequence이 만들어지게 되는 것이다.

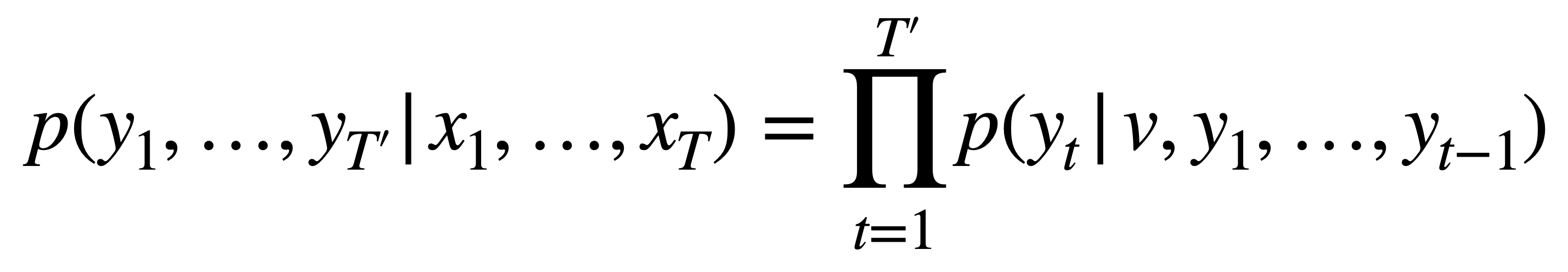

이러한 Encoder-Decoder 구조는 다음과 같은 조건부 확률로 모델링할 수 있다. 위 식을 풀어 설명하자면, 입력 $(x_1, x_2, \dots, x_T)$가 순서대로 주어졌을 때 출력 $(y_1, y_2, \dots, y_{T^\prime})$이 순서대로 주어질 확률이고, 이 확률은 각 time step에서 출력값($y_t$)가 나올 확률들을 곱해서 계산할 수 있다.

LSTM Sequence Model

본 논문에선 2개의 LSTM이 연결된 Seq2Seq 모델을 제안하고 있다. 기존 RNN 기반 Seq2Seq에 3가지 차별점을 두어 더욱 향상된 성능을 보였다고 한다. 3가지 차별점을 차례대로 살펴보자.

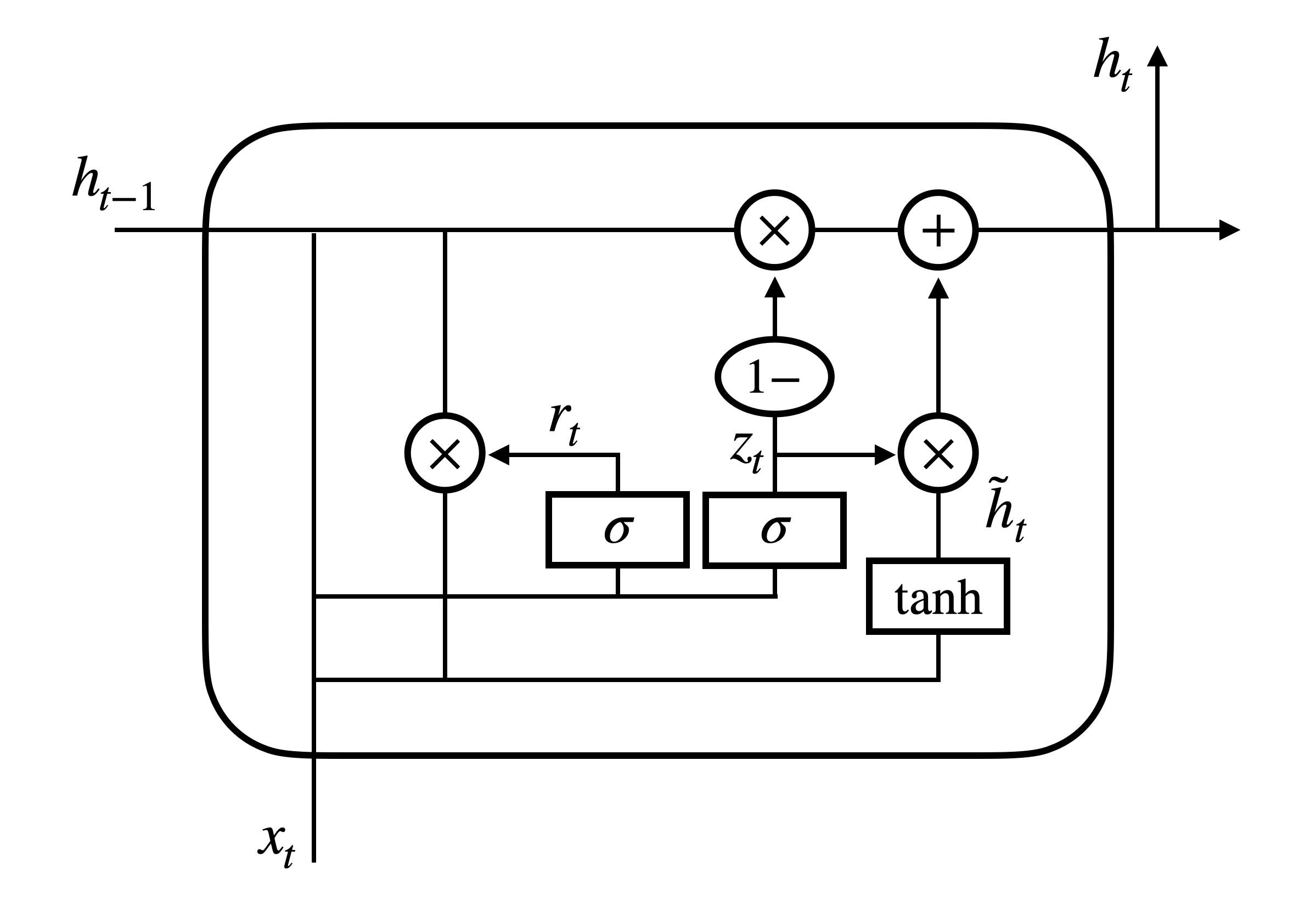

Using Two Different LSTMs

첫 번째 차별점은 RNN 대신 LSTM Encoder, Decoder를 사용했다는 것이다. 이는 RNN의 대표적인 단점인 Long Term Dependency 문제를 해결하기 위해서이다. Long Term Dependency는 먼 과거의 정보를 현재 학습에 사용하지 못하는 문제이다. 예를 들어 "어린 왕자는 작은 별에서 장미꽃을 만났다. 그리고 ( )은 그에게 소중한 존재가 되었다." 라는 문장이 주어졌고, 괄호 안에 들어갈 단어가 "장미꽃" 일 때 괄호 속 단어를 예측하기 위해선 이전에 나온 "장미꽃"을 활용해야 한다. 때문에 과거의 정보가 현재 학습에 중요한 영향을 미치게 된다. 그러나 과거 정보가 거의 사라진다면 괄호 속 단어를 예측할 수 없게 되고, 이런 문제를 Long Term Dependency 라고 한다.

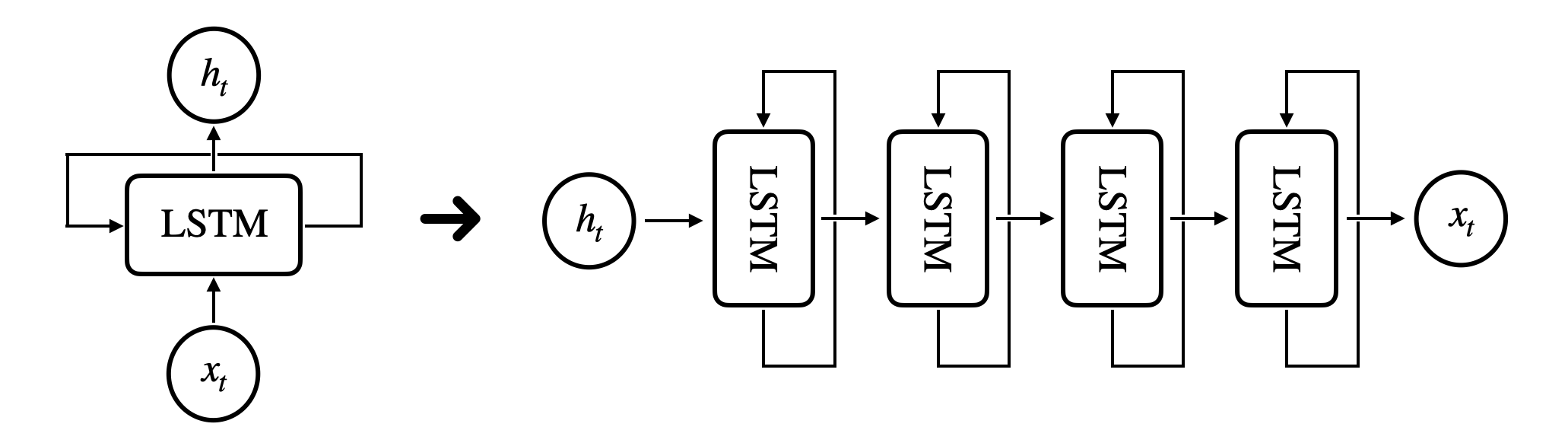

Deep LSTMs

두 번째 차별점은 Single Layer Model이 아닌 Deep LSTM을 사용했다는 점이다. 4개의 layer를 쌓아 만든 모델은 1개의 layer만 사용한 모델보다 훨씬 좋은 성능을 보였다고 한다.

Reversed Order Input Sequence

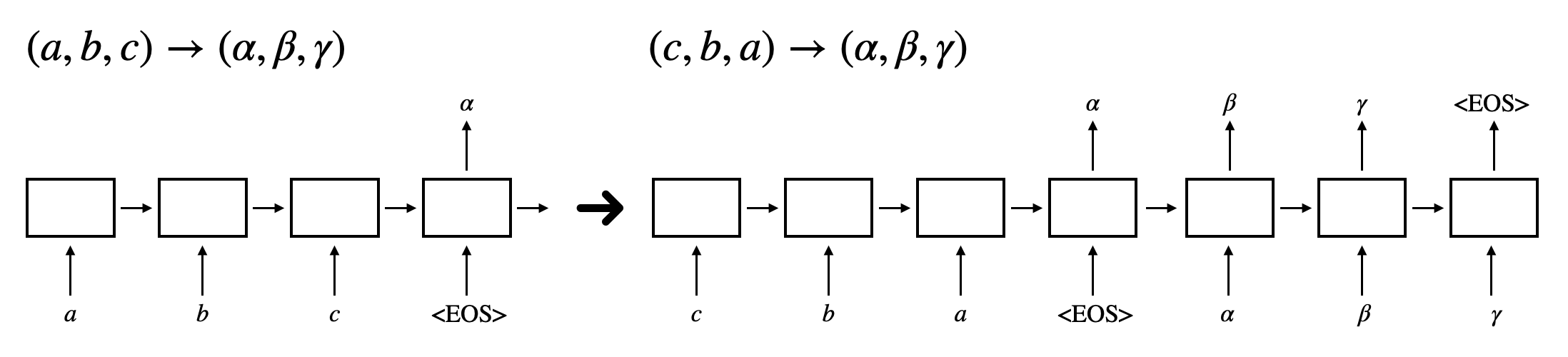

세 번째 차별점은 Input Sequence의 차원을 뒤집었다는 것이다. 위 그림에서 Input Data는 $(a, b, c)$ 이고, 이에 대응하는 Output Data는 $(\alpha, \beta, \gamma)$ 이다. 이때, Input의 순서를 Sequence 순서가 아닌 그 반대의 순서로 정하는 것이다. 이렇게 되면 $a$와 $\alpha$의 거리는 가까워지고, 초기 단어 $a$의 정보를 뒤에 위치하는 단어 $\gamma$까지 충분한 영향을 미칠 수 있게 된다.

Object Function & Inference

위에서 설명한 모델을 본격적으로 학습시켜보자.

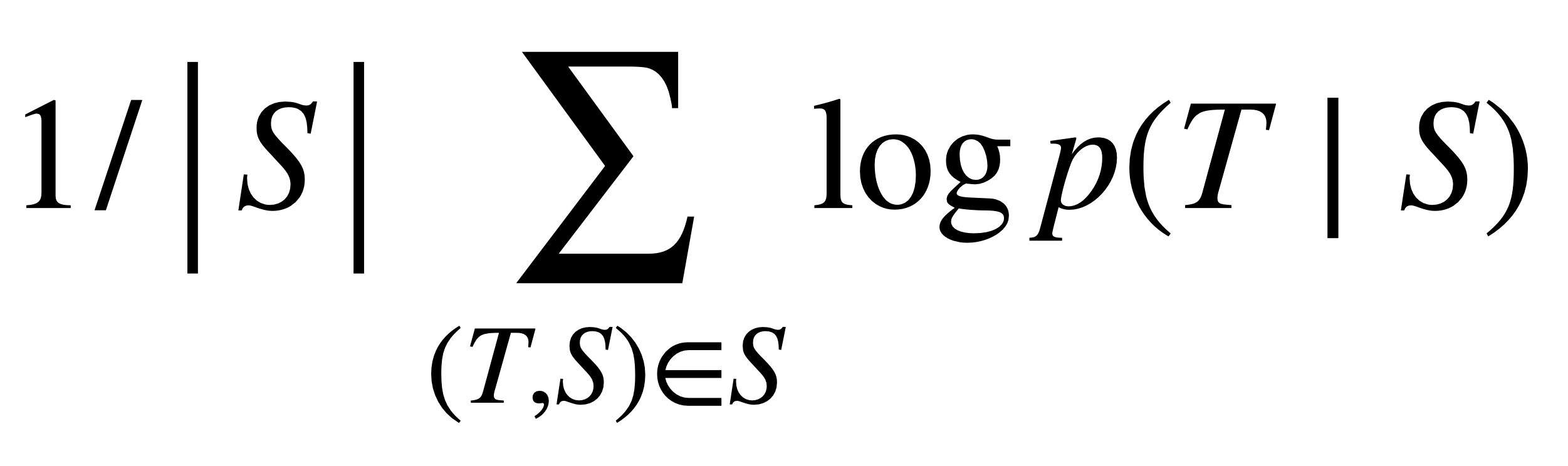

학습의 목적은 Input Sentence와 짝지어진 Target Sentence로 Output Sentence가 출력되는 것이다. 그렇기 때문에 Input Sentence $S$가 주어졌을 때, Target Sentence $T$가 일어날 확률의 로그 값을 최대화 시키는 방향으로 모델을 학습시킨다. 다시 말해, Maximum Likelihood Estimation(최대우도법)을 해당 모델의 Object Function으로 사용하게 된다.

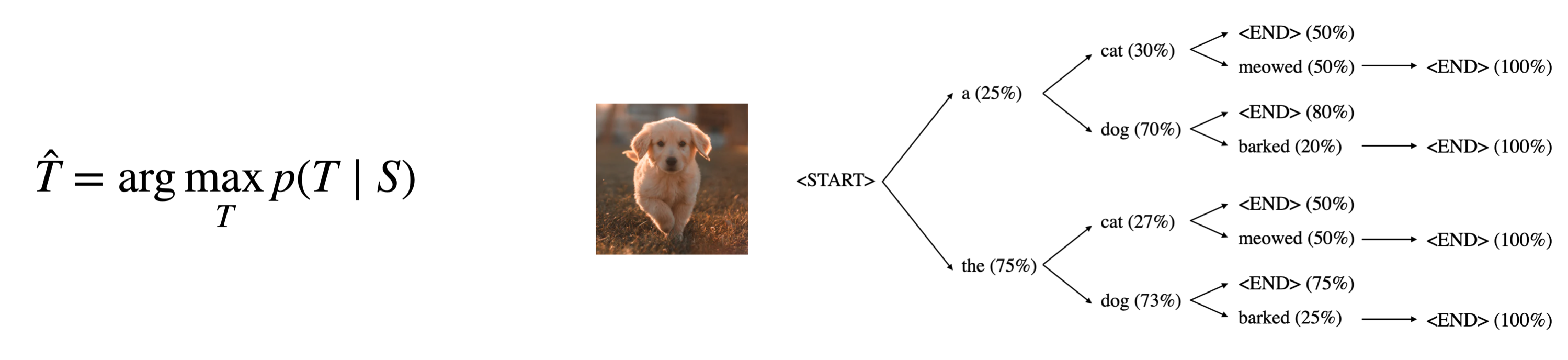

학습이 완료되면 위 수식에 따라 $S$가 주어졌을 때 $T$가 주어질 확률이 가장 큰 $\hat{T}$을 최종 Output Sentence로 선택하게 된다. 이 과정에서 Beam Search가 사용되는데, 이는 Decoder의 매 time step에서 미리 정의한 $k$(Beam Size)개 만큼 후보 값을 출력하고, 그 후보 값에서 다시 $k$개의 후보를 출력한다. 이렇게 나온 후보 값들을 조합한 결과 중 score 값이 가장 큰 결과를 최종 결과로 선택하는 방식이다.

Metric

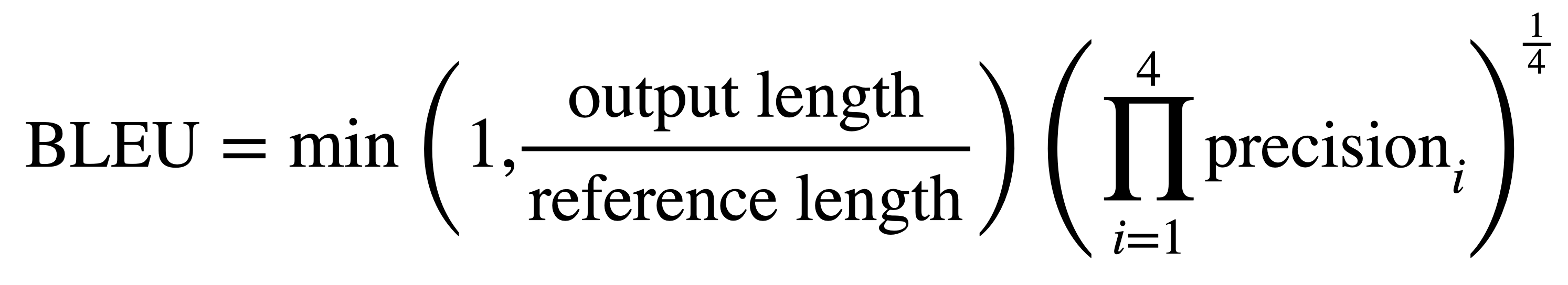

최종 결과에 대한 평가는 BLEU score를 사용한다. BLEU는 Output Sentence와 Reference Sentence 사이 겹치는 단어의 수와 예측 문장의 길이를 고려하여 두 문장 사이의 유사성을 측정하는 지표이다.

Brevity Penalty

- $\min \left( 1, {\text{output length} \over{\text{reference length}}} \right)$

문장의 과적합을 방지하기 위한 수식으로 Output Sentence의 길이가 Reference Sentence 길이보다 큰 경우 점수를 1로 설정해 길이에 따라 점수가 올라가는 것을 막았다.

n-gram

- $\left( \prod^4_{i=1} \text{precision}_t \right)^{1 \over 4}$

Reference Sentence과 Output Sentence 사이에서 n개의 단어를 묶어 겹치는 정도를 계산하는 수식이다. 이때, Clipping을 사용해 단어의 겹치는 정도를 Reference Sentence에 존재하는 개수로 제한했다. 즉, 정답 문장에 apple이라는 단어가 1번 나오고 예측 문장에선 3번 나온다면 겹치는 정도를 3이 아닌 1로 제한하여 점수의 신뢰도를 높였다.

Result

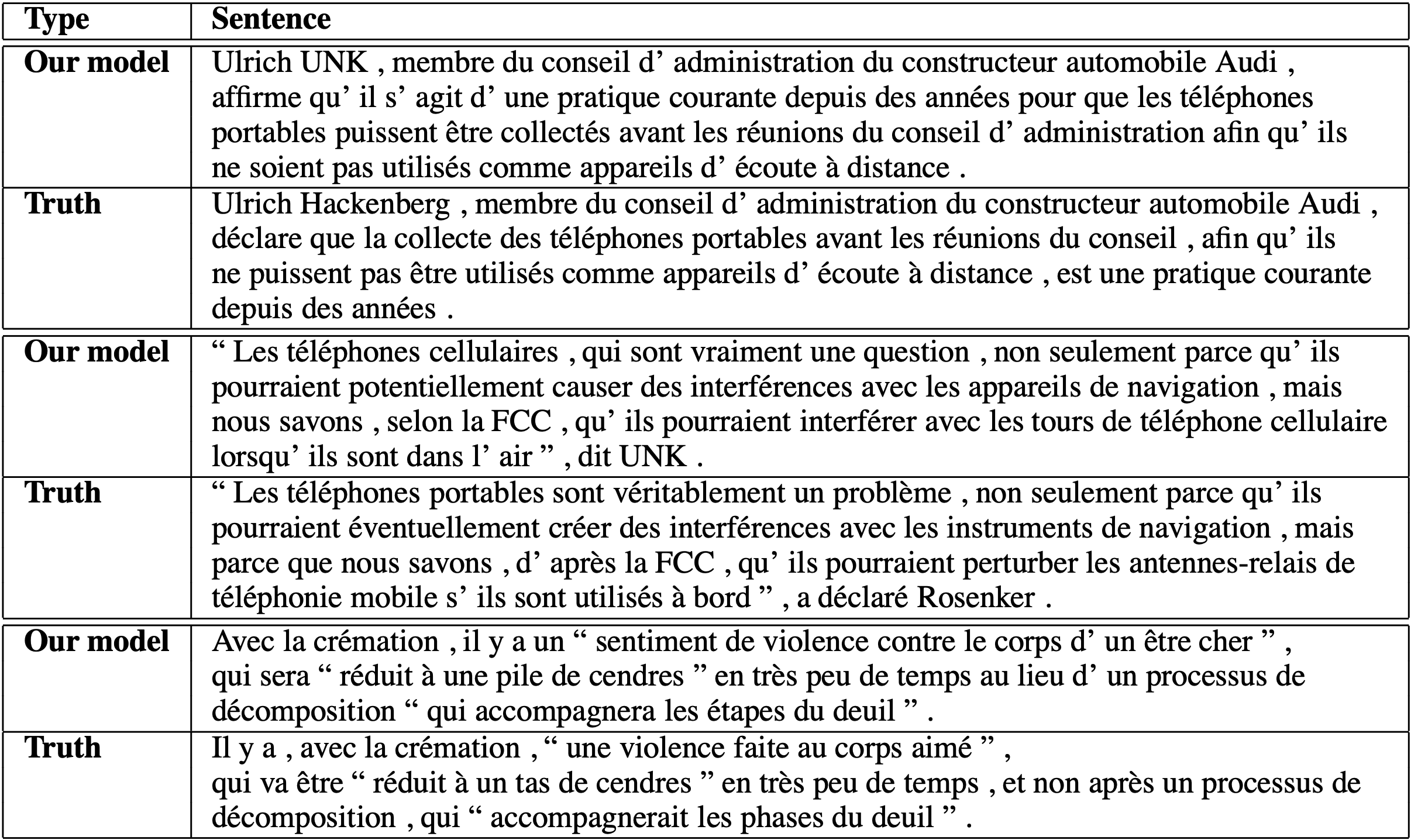

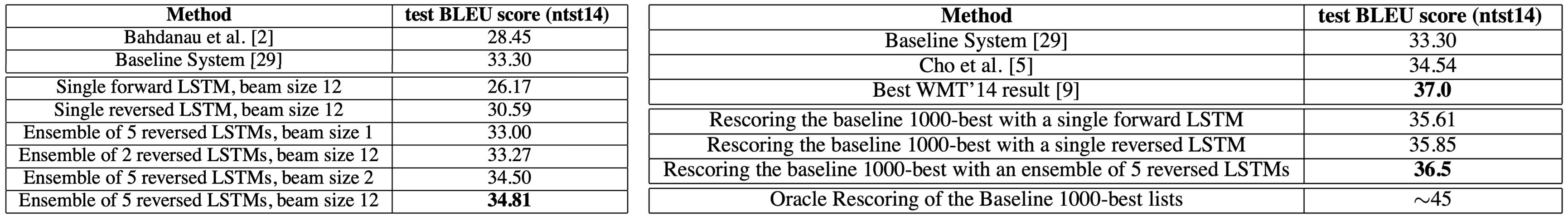

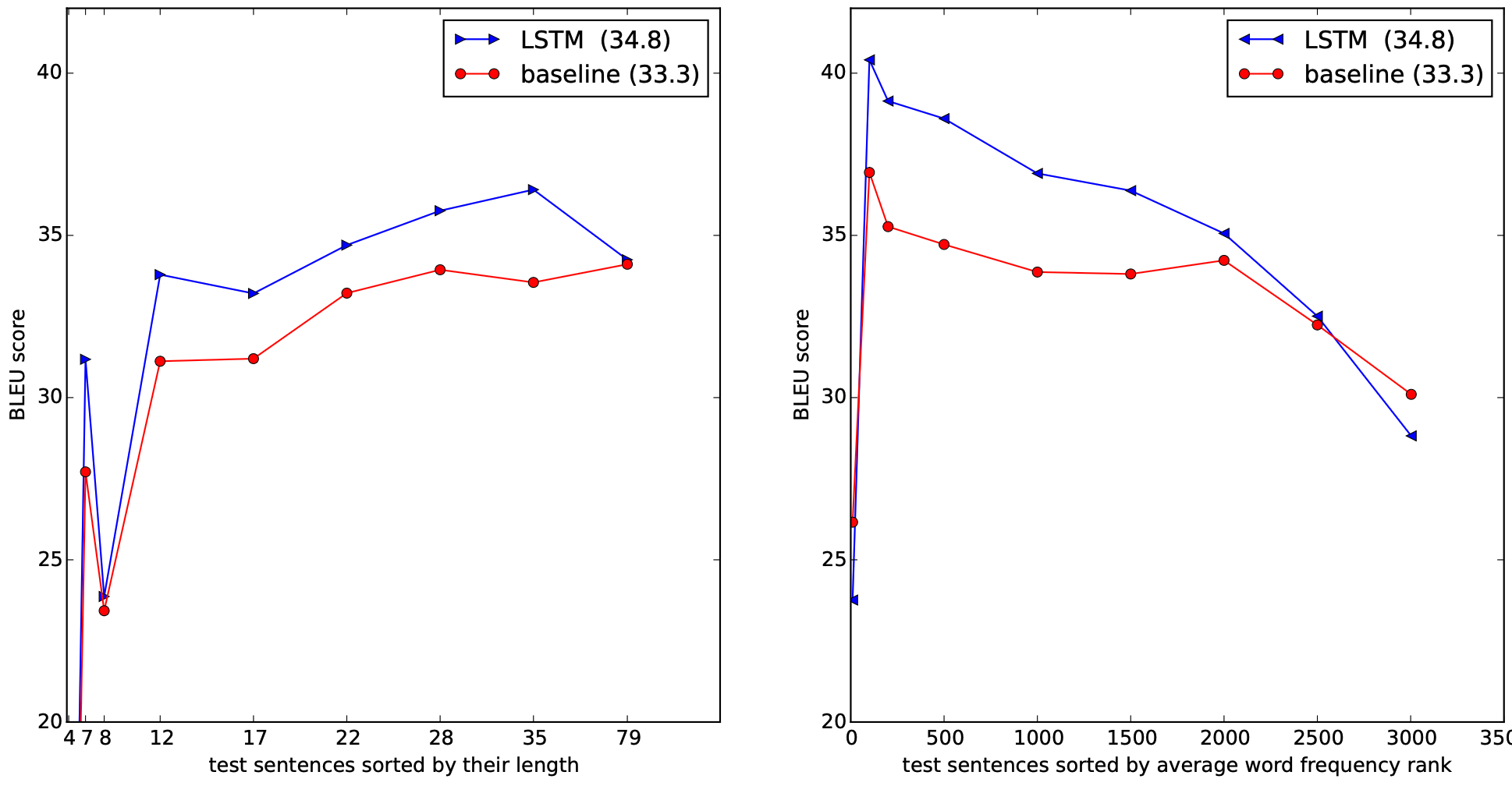

논문에서 제안한 모델로 학습한 결과는 다음과 같다. 모델이 출력한 문장과 Truth 문장을 비교하여 나타내고 있다. 좀 더 자세한 결과를 위에서 설명한 BLUE score와 Output Sentence를 비교한 결과를 차례로 살펴보자.

BLUE score

먼저 BLUE score의 결과이다. LSTM Seq2Seq 모델 결과 5개를 앙상블 한 결과 SOTA 모델을 앞지르지는 못했지만 처음으로 Neural Network의 성능이 SMT(Statistical Machine Translation) 모델 성능을 뛰어 넘었다고 한다. 이를 모델별 BLUE score를 비교하며 설명해주고 있다.

Output Sentence

다음은 출력된 문장에 따른 모델 성능을 비교한 내용이다.

문장 길이에 따른 모델 성능을 비교한 그래프로, 문장 길이가 길어져도 어느 정도 성능을 유지한다는 것을 알 수 있다.

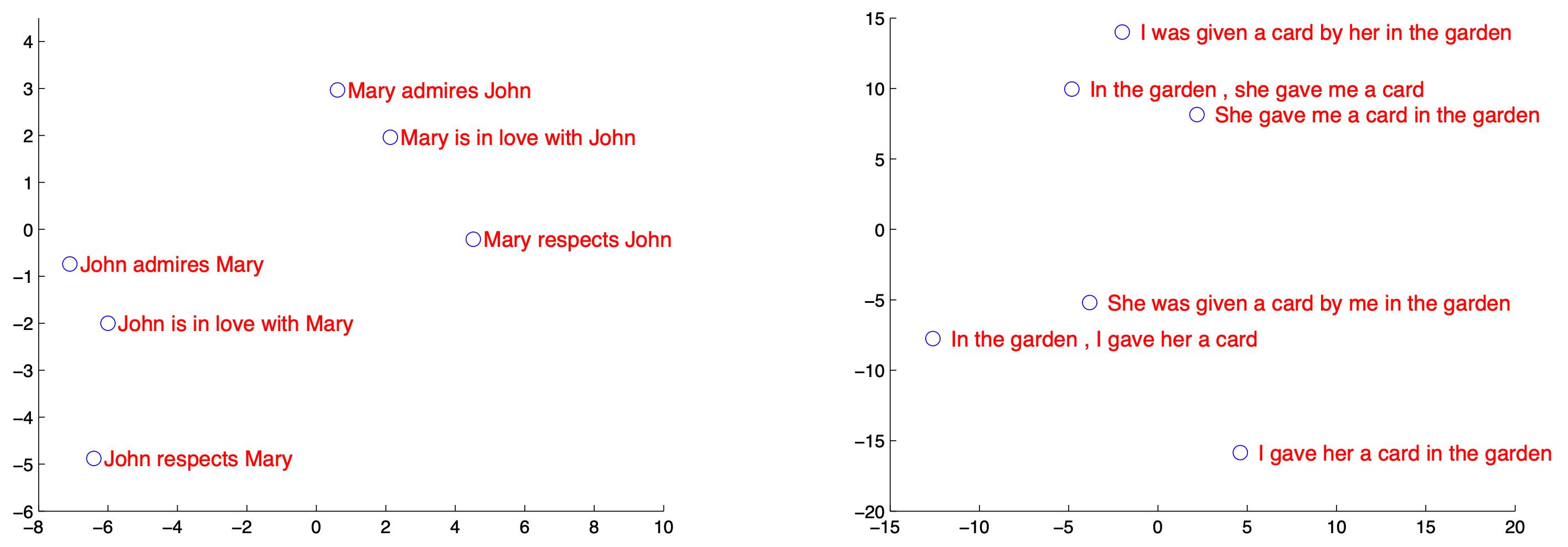

이 그래프는 제안한 모델의 결과를 PCA를 사용해 2차원 평면에 나타낸 결과로 단어 순서에 따라선 민감하게 반응하지만 문장의 수동, 능동 형태에 따라선 큰 영향을 받지 않는다는 걸 볼 수 있다.

Conclusion

본 논문에선 LSTM을 Encoder, Decoder로 사용하는 Sequence to Sequence 모델을 제안하고 있다. Seq2Seq와 Single RNN, LSTM 과의 차이점이 무엇인지, 왜 사용하는지 알 수 있었고 무엇보다 어떻게 동작하는지 정리할 수 있어서 뜻깊은 리뷰였다. 특히, Input Sequence의 차원을 뒤집어 사용한다는 점이 인상깊었고, 이전에 정리했던 MLE를 Object Function으로 사용한다는 점을 보고 딥러닝에서 MLE가 어떤 식으로 활용되는지 공부할 수 있어서 좋았다.

다음 리뷰할 논문은 Show and Tell: A Neural Image Caption Generator로 Seq2Seq 모델을 응용해 Encoder는 CNN, Decoder는 RNN으로 구성한 Image Caption 모델에 대해 공부하려 한다.

'📒 Jero's Review > Paper' 카테고리의 다른 글

| Three Scenarios for Continual Learning (0) | 2024.06.12 |

|---|---|

| Attention Is All You Need (0) | 2024.05.25 |

| Show and Tell: A Neural Image Caption Generator (1) | 2024.05.10 |